Anthropic bringt „Claude Managed Agents“ auf den Markt: Die KI-Agenten-Infrastruktur beginnt mit der Abrechnung von 0,08 $ pro Stunde und senkt die Entwicklungszeit drastisch.

Anthropic schaltet offiziell Preisschilder für die AI-Agent-Infrastruktur: 0,08 $ pro aktivierte Ausführungsstunde, Notion, Rakuten, Asana und Sentry gehören zu den ersten Unternehmen, die es nutzen.

(Zur Vorgeschichte: Anthropic übernimmt die zugrunde liegende Architektur für AI Agents: Notion und Rakuten sind die ersten, die live gehen, die Latenz sinkt um bis zu 90 %)

(Zusätzliche Hintergründe: Hochwertige KI-Modelle driften in unterschiedliche Richtungen: ChatGPT nach C, Claude nach B)

Inhaltsverzeichnis

Umschalten

- Von „einigen Monaten“ auf „einige Tage“ komprimiert

- Die Rechnung von 0,08 $

- Die Richtung der Auslagerung (Managed Services) und der erste Preismaßstab des Marktes

Pro Stunde 8 US-Cent klingt nach nicht viel. Wenn aber ein KI-Agent täglich 8 Stunden ausführt und im Monat volle 30 Tage läuft, beträgt die Rechnung 19,2 US-Dollar. Das sind noch nicht einmal Token-Gebühren eingerechnet. Anthropic hat heute (9) Morgen offiziell bekannt gegeben, dass Claude Managed Agents in den öffentlichen Test (public beta) übergehen und einen Preismaßstab veröffentlicht, wie das Unternehmen seine gehosteten AI-Agents bepreist.

Introducing Claude Managed Agents: everything you need to build and deploy agents at scale.

It pairs an agent harness tuned for performance with production infrastructure, so you can go from prototype to launch in days.

Now in public beta on the Claude Platform. pic.twitter.com/vHYfiC1G56

— Claude (@claudeai) April 8, 2026

Von „einigen Monaten“ auf „einige Tage“ komprimiert

Die zentrale Ausrichtung von Claude Managed Agents ist nicht, ein besseres Sprachmodell zu sein, sondern ein API-Baukastensystem, das Unternehmen die Infrastrukturaufbauphase überspringen lässt. Laut Anthropic braucht es bislang, damit ein KI-Agent-Prototyp vom Entwurf bis zum offiziellen Go-live gelangt, „monatelange Infrastrukturarbeit“: Sandbox-Umgebungen, Identitätsprüfung, Tool-Ausführungspipelines, Zustandsverwaltung für lang andauernde Ausführungen – alles jeweils von Ingenieuren von Grund auf aufgebaut.

Mit Managed Agents ist Anthropics Argument: all das übernehmen sie. Für das Unternehmen bleibt nur, zu definieren, was der Agent tun soll, und dann zu deployen.

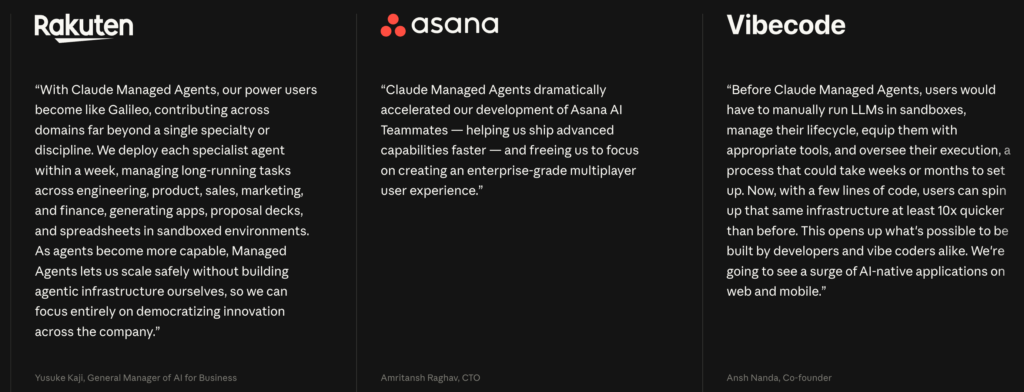

Anthropic hat Daten mehrerer Kunden nach der Nutzung veröffentlicht:

Sentry hat ihre Debugging-Agents Seer mit einem Claude-getriebenen Agenten gekoppelt; letzterer schreibt die Fixes und erstellt PRs, sodass Entwickler den Weg von der Bug-Erkennung bis zum Erhalt eines prüfbaren Fixes in einem einzigen Prozess erledigen können.

Bei Rakuten geht es noch extremer zu: Unternehmens-Agents, die Produkt, Vertrieb, Marketing und die Finanzabteilung abdecken – jeder ist in „innerhalb einer Woche“ deployt, verbunden mit Slack und Teams. Mitarbeitende können Aufgaben an den Agenten übergeben und bekommen als Ergebnis Tabellen, Präsentationsfolien oder fertige Anwendungen zurück.

Vibecode erwähnte, dass nach der Integration von Managed Agents als Standard die Kunden dabei unterstützt werden, von Prompt bis Deployment eine komplette App zu bekommen – mit einer Startgeschwindigkeit, die beim Setup derselben Infrastruktur „mindestens 10-mal schneller“ ist.

Die Aussagekraft dieser Zahlen lässt sich nicht unabhängig verifizieren, aber die Logik ist stimmig: Anthropic verkauft Zeit von Ingenieuren. Der gehostete Service schluckt die Komplexität, und der Preis dafür ist genau diese $0,08/session-hour.

Die Rechnung von 0,08 $

Das Preismodell besteht aus zwei Ebenen: den Token-Gebühren der Standard-„Claude Platform“ (Abrechnung nach Nutzung) sowie den zusätzlichen 0,08 $ für die Ausführungszeit.

Wenn ein einzelner Agent pro Arbeitstag 8 Stunden läuft, liegen die monatlichen Kosten bei etwa 14 $, und die tatsächliche Rechnung hängt nach Hinzufügen der Token-Nutzung von der Art der Aufgabe ab. Aber bei Deployments auf Unternehmensebene ist die Anzahl der Agents der entscheidende Multiplikator. Wenn Rakuten beispielsweise in vier Abteilungen jeweils mehrere Agents laufen lässt, wirkt sich die Anzahl der gleichzeitig ausgeführten Sessions sehr direkt auf die Monatskosten aus.

Interne Tests bei Anthropic zeigen, dass bei strukturierten Aufgaben zur Generierung von Dateien die Aufgaben-Erfolgsquote von Managed Agents „höchstens 10 Prozentpunkte“ höher liegt als bei der standardmäßigen prompting loop, und die Verbesserungen sind besonders deutlich bei den schwierigsten Problemen. Das bedeutet jedoch: Es sind Best-Case-Ergebnisse, nicht der Durchschnitt, und die Schwierigkeitsparameter für die Basisaufgaben sind nicht veröffentlicht.

Aus der Beschaffungslogik der Kunden heraus ist es ziemlich unwahrscheinlich, dass die Begründung für die Übernahme genau diese 10 Prozentpunkte sind. Viel zentraler ist die Komprimierung der Entwicklungszyklen. Asana hat „AI Teammates“ aufgebaut, die in Projekten mit Menschen zusammenarbeiten, Aufgaben übernehmen und Abgabedokumente entwerfen; nach eigenen Angaben wird mit Managed Agents die Entwicklung fortgeschrittener Funktionen deutlich beschleunigt.

Notion ermöglicht es Nutzern, Arbeit innerhalb ihres Workspace direkt an Claude zu delegieren; Dutzende von Aufgaben können parallel ausgeführt werden (aktuell noch in private alpha).

Für die Produktteams dieser beiden Firmen bedeutet das: Kein eigenes Session-Management und kein Rahmen für die Koordination mehrerer Agents, was im Ergebnis dazu führt, dass Ingenieure ihre Zeit in Produktdifferenzierung investieren – statt in die Wartung von Infrastruktur.

Der entscheidende Trade-off liegt in der Größenordnung. Bei geringer Nutzung sind die Kosten für den Eigenaufbau höher; bei großskaligem Deployment wird der kumulierte Effekt der 0,08 $ erst dann neu betrachtet.

Die Richtung der Auslagerung und der erste Preismaßstab des Marktes

Aus einer größeren Perspektive betrachtet ist die Veröffentlichung von Claude Managed Agents ein konkretes Signal dafür, dass sich der AI-Agent-Markt in Richtung „SaaSisierung“ bewegt.

In den vergangenen zwei Jahren war der übliche Weg, um in Unternehmen AI-Agents aufzubauen: eine Modell-API auswählen, eine Orchestration-Schicht selbst bauen, selbst die Tool-Ausführungsumgebung verwalten und selbst den Zustand für lang andauernde Ausführungen handhaben.

Anthropics Ansatz ist, diese Komplexität in sich aufzunehmen und als Bestandteil der Monatsgebühr auszuweisen. Das ist keine neue Idee – AWS, Azure und GCP machen das seit über einem Jahrzehnt. Aber auf dieser Ebene von AI Agents ist „0,08 $/session-hour“ der erste öffentlich transparente Marktpreismaßstab, dem man bisher begegnet ist.

Koordination mehrerer Agents (Multi-agent coordination) befindet sich derzeit noch in der research preview-Phase und muss beantragt werden, was bedeutet: Für die komplexesten Aufgaben-Szenarien – in denen Agents andere Agents starten und anleiten können, um Arbeiten parallel zu erledigen – ist noch nicht alles vollständig geöffnet.

Das ist auch die vielversprechendste Variable für die Preisentwicklung als Nächstes: Wenn Agents automatisch mehr Agents „reproduzieren“ können, wie wird dann die Abrechnungseinheit von 0,08 $ entsprechend angepasst?

Anthropic hat diese Frage nicht beantwortet. Aber die Existenz der öffentlichen Testversion bedeutet, dass sie bereit sind, den Markt zunächst laufen zu lassen – und Zahlen für sich sprechen zu lassen.